国際情報学部

国際情報学部 学部長・教授 平野晋が〈日本データベース協会〉のDBSJセミナーにおいて、「自動運転車の派生型トロッコ問題~ドイツの倫理原則と大衆の選好との乖離を考える~」を報告しました

2022年03月01日

国際情報学部学部長・教授 平野晋

2022年1月26日、国際情報学部 学部長・教授の平野晋が〈日本データベース協会〉のDBSJセミナーにおいて、「自動運転車の派生型トロッコ問題~ドイツの倫理原則と大衆の選好との乖離を考える~」を報告しました。

国際情報学部学部長・教授 平野晋の専門分野はアメリカ法、製造物責任法、及びサイバー法です。著書に『アメリカ不法行為法』や『ロボット法』等があります。

また、平野はこれまで、国内においては総務省の「AIネットワーク社会推進会議」や内閣府の「人間中心のAI社会原則会議」に、国外においてはOECD「AIGO:AI expert Group at the OECD」(AI専門家会合)に参画しており、AIの開発や利活用に関する議論に貢献し、かつ自動運転のいわゆる〈派生型トロッコ問題〉も国際会議や法律雑誌にて紹介してきました。詳細はこちらのページをご覧ください。

また前年12月に平野は、〈情報法制学会〉の第5回研究大会において、「自動運転車のトロッコ問題と〈設計上の欠陥〉」を報告しました。

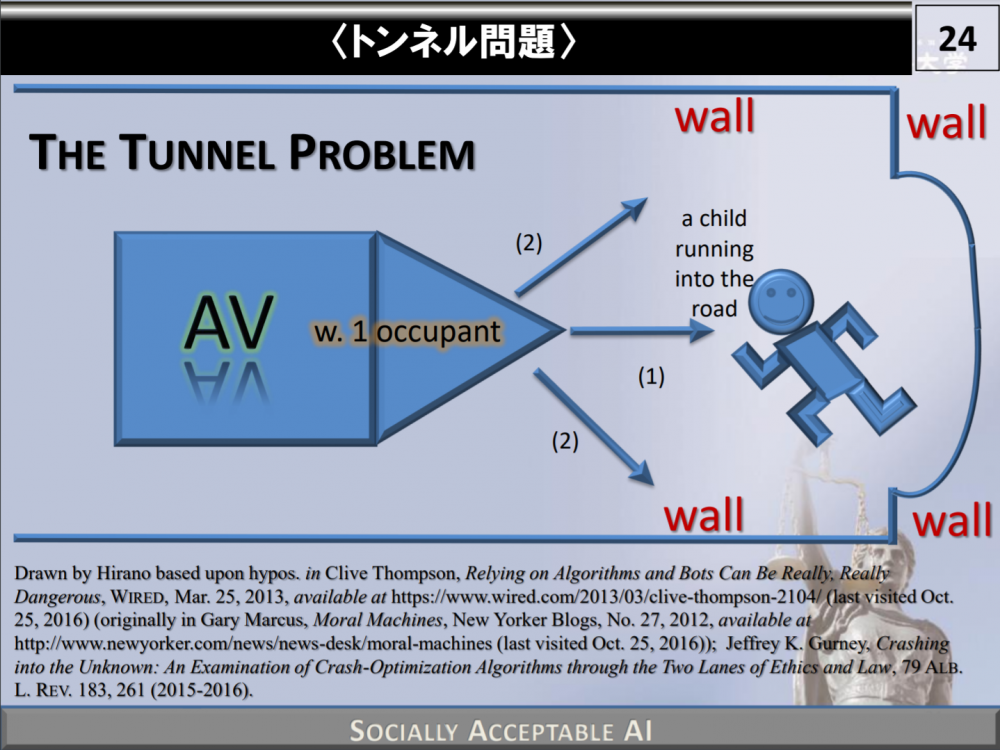

今回の〈日本データベース協会〉のDBSJセミナーにおける報告で平野は、自動運転における派生型トロッコ問題の起源と概要をまず説き起こしました。

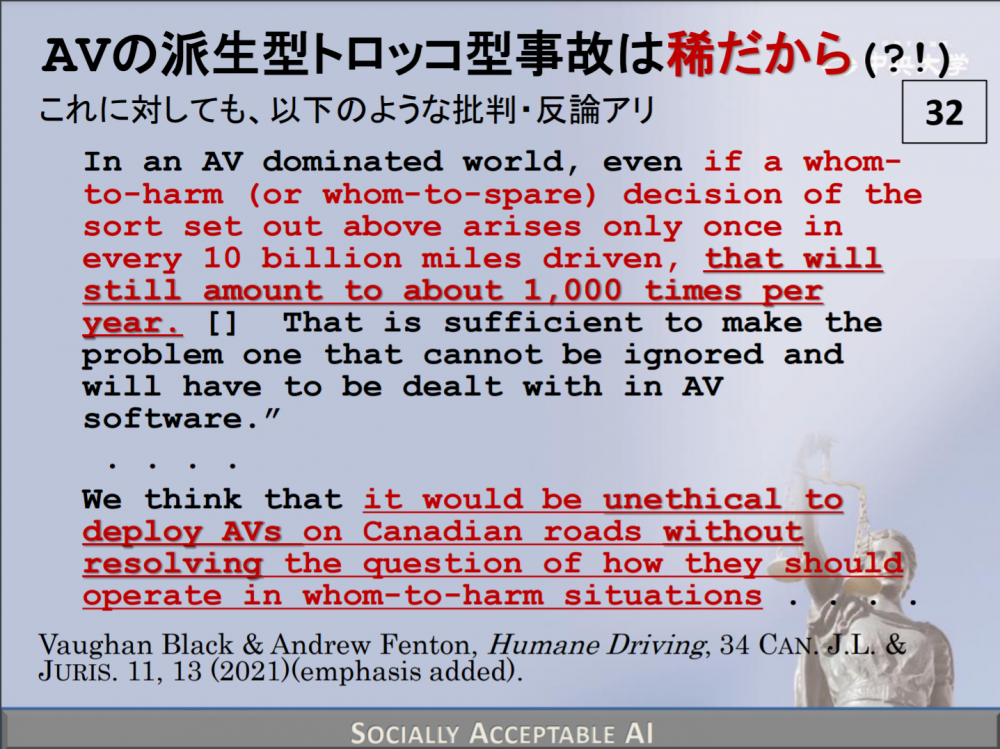

続けて、解決策が容易に見い出せない派生型トロッコ問題は、自動運転の研究開発や普及を妨げ、かつ稀な事故に過ぎないからという理由に基づき、これを論じるべきではないと主張する無用論が散見される事実も、平野は紹介。

しかし、そのような派生型トロッコ問題無用論は、根拠が薄弱であり非倫理的である論拠も平野は外国文献を通じて紹介し、同問題を無視すべきではないと主張しました。

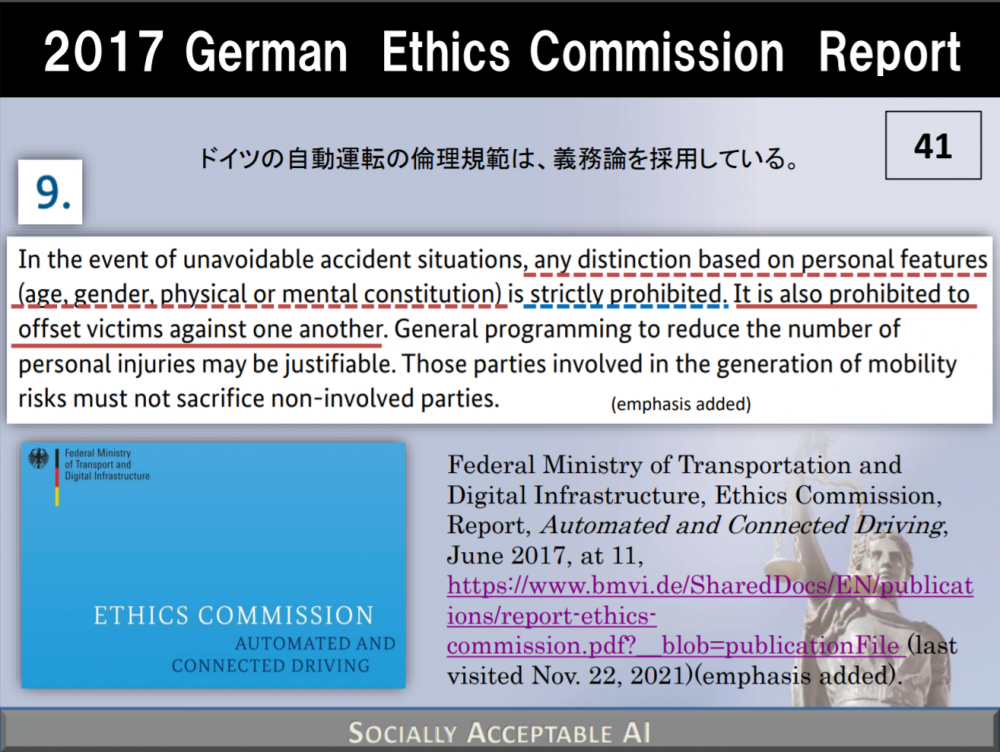

加えて、ドイツが2017年に公表した自動運転の倫理勧告の問題点も以下のように紹介しました。自動運転車が、例えば子供と衝突するか/大人と衝突するか、または女性と衝突するか/男性と衝突するかの二者択一を迫られた場合に、年齢や性別等の属性を考慮することを一切厳に禁じる、とドイツの倫理勧告は要求しています。

しかし『ネイチャー』誌に掲載された論文によれば、世界中の多くの人々に対する調査の結果、やむをえない衝突時の人命の選択においては、多くの人々が子供を優先して守るべきとこたえており、男性よりも女性を優先して保護すべきと、多くの地域の人々がこたえています。

そのような大衆の選好に、ドイツの勧告は反していると指摘されている事実を平野は報告し、多くの国民感情に反するような勧告に、ドイツ以外の国々が安易に追従すべきではないと報告しました。

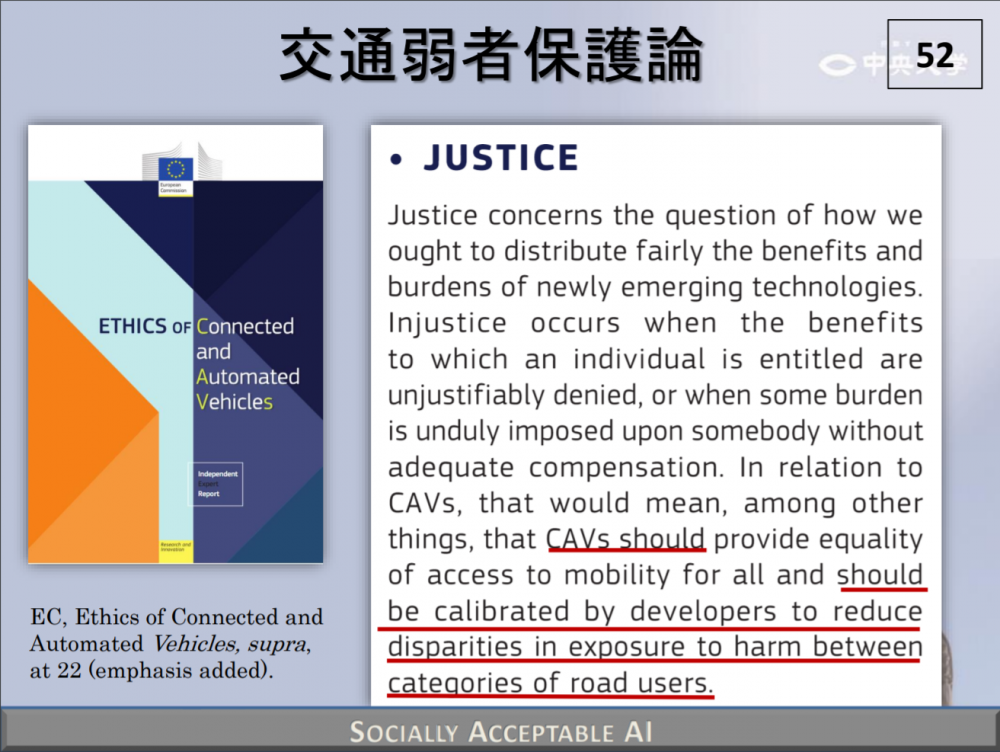

報告の最後に、平野は、EU欧州委員会の専門家会議が2020年に公表した自動運転の倫理勧告も取り上げて、その勧告が、交通弱者への配慮を自動運転の開発設計や実装に求めている事実と、そのような方針の採用・実施の前には、包摂的に広く市民を参加させた熟議によるコンセンサスの形成が不可欠であると主張している事実を指摘しました。

その上で、安易に自社製自動運転車の乗員の命や安全性を、歩行者などの路上の第三者の命や安全性よりも優先させる設計姿勢は、大衆の反感を買うおそれがある点を、過去の炎上事例を例示して紹介。

そこで日本も、先述の勧告を見倣うべきであると主張して、報告を締めくくりました。